Inteligencia Artificial - Artificial Intelligence · El boletín informativo que llega los lunes a las 00:01 CET

Las noticias más relevantes de los últimos 7 días recopiladas y analizadas por y para creativos entusiastas de la Inteligencia Artificial - Artificial Intelligence ¡Tira del hilo, tira del link!

IA-AI LANGUAGE MODELS & AGENTS 🧠

GEMINI lanza dos herramientas para facilitar la migración desde otros asistentes de IA: importación de memoria e importación del historial de conversaciones. La primera permite copiar un prompt sugerido en la app de origen, pegar la respuesta en Gemini y que este guarde automáticamente las preferencias y el contexto personal del usuario. La segunda permite subir un archivo ZIP con el historial completo de chats para continuar conversaciones previas sin perder el hilo. Ambas opciones están accesibles desde los ajustes, aunque quedan excluidas las cuentas corporativas, los menores de 18 años y los usuarios del Espacio Económico Europeo, Reino Unido y Suiza, o sea, unos cuantos, pero cabe esperar que la implementación sea gradual. Google aprovecha el lanzamiento para renombrar la función “chats anteriores” como memoria. Para creativos que han construido contexto de trabajo en otras herramientas, estas funciones eliminan uno de los principales frenos al cambio de asistente.

CHATGPT estrena Library, una pestaña en la barra lateral web que centraliza todos los archivos subidos o generados en la plataforma, accesibles desde cualquier conversación sin necesidad de recuperar el hilo original. Incluye buscador, filtros por tipo de archivo y un acceso rápido a los documentos más recientes desde el compositor. Hay un cambio relevante en la lógica de almacenamiento: eliminar una conversación ya no borra los archivos que contenía, que permanecen en la Library hasta que el usuario los elimine manualmente. De momento solo está disponible en la versión web para suscriptores de Plus, Pro y Business, con despliegue gradual. X

IA-AI CREATIVE SUITES (AI HUBS/AGREGADORES) 🏨

KREA EDIT incorpora una nueva función llamada Annotations que permite editar imágenes asignando prompts independientes a zonas específicas de la imagen, en lugar de aplicar un único texto a todo el conjunto. El sistema permite definir regiones concretas —mediante rectángulos dibujados manualmente o con la función Auto Mask, que detecta áreas automáticamente al pasar el cursor— y asignar a cada una una instrucción diferente en lenguaje natural, sin necesidad de sintaxis especial. El resultado aparece en el lienzo principal con miniaturas de versiones anteriores para comparar o revertir cambios, y desde ahí se puede enviar directamente al Enhancer o al generador de vídeo de Krea. La edición por anotaciones reduce drásticamente el número de iteraciones necesarias para ajustar composiciones complejas, acercando el flujo de trabajo de IA al de herramientas de retoque por capas que ya conocemos bien. X

© Krea

FREEPIK ha lanzado 3D Scenes/Escena Virtual, una herramienta experimental que convierte una imagen en un entorno 3D navegable para montar escenas, colocar objetos, mover la cámara como en una sesión real y mantener una iluminación y un nivel de detalle consistentes desde distintos ángulos; en la práctica, apunta a usos como fotografía de producto, composición visual, previsualización de sets e interiorismo, con la ventaja de poder reutilizar la misma escena en varias tomas sin reconstruirla cada vez. X

© Freepik

IA-AI COMFYUI c

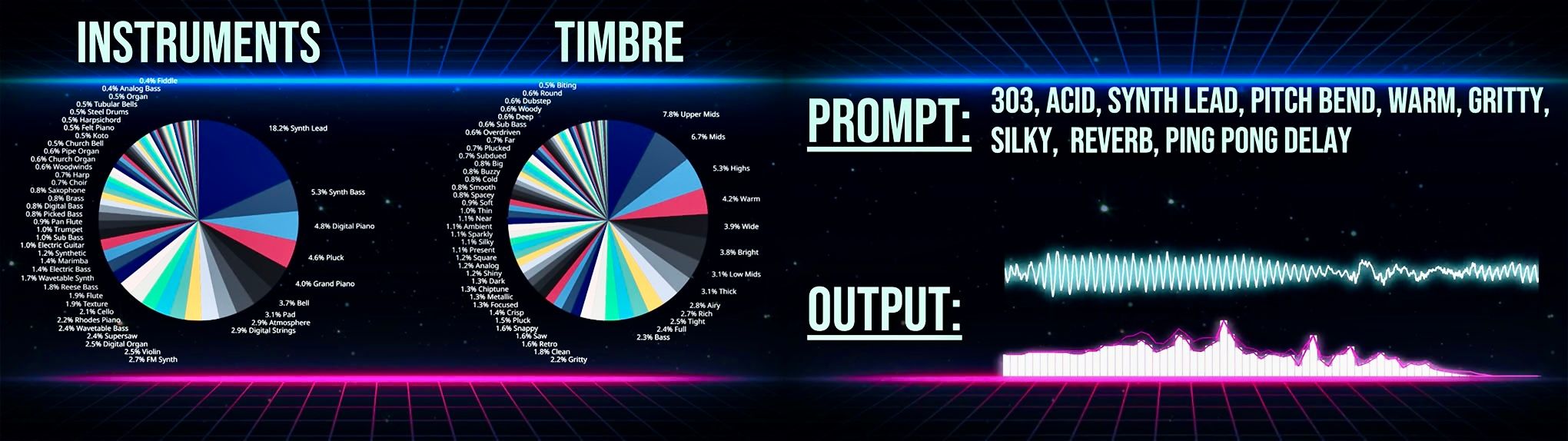

FOUNDATION-1 es un modelo gratuito y local de generación de samples mediante texto, desarrollado por RoyalCities sobre la base de Stable Audio Open 1.0. A diferencia de otros modelos de audio, está diseñado para producir loops sincronizados con tempo y tonalidad, con un sistema de prompting por capas que controla familia de instrumento, timbre y efectos de forma independiente. Requiere unos 7 GB de VRAM, genera un sample en torno a 8 segundos en una RTX 3090, tiene integración con ComfyUI y su licencia permite uso comercial para estudios con facturación inferior al millón de dólares. Para productores y compositores, representa una opción de experimentación local sin depender de suscripciones externas. HUGGING FACE SPACES TEST

© Royal Cities

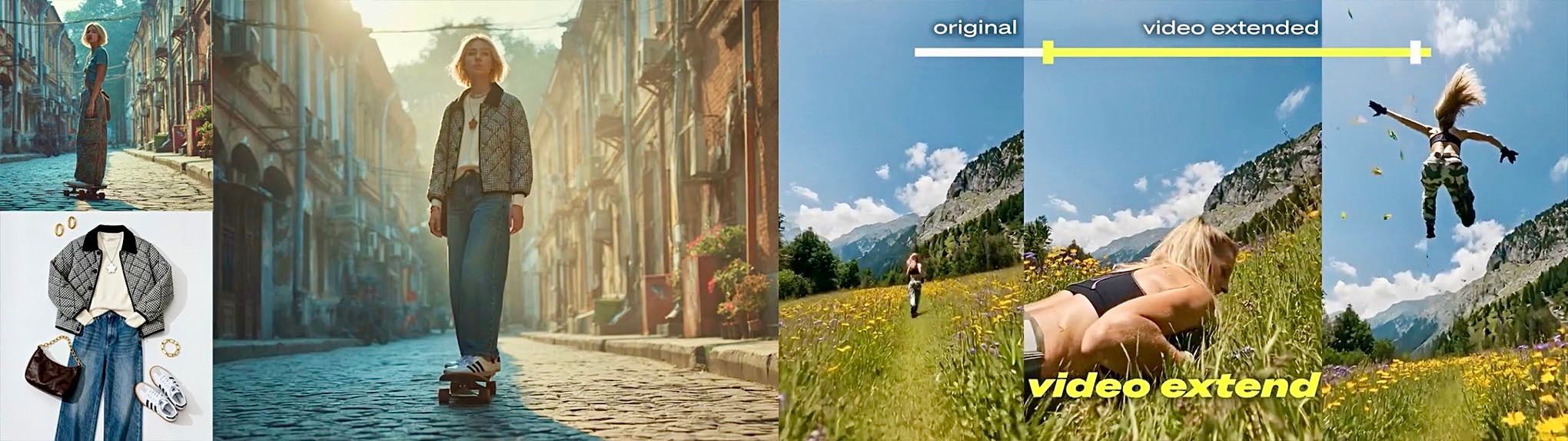

GROK IMAGINE ComfyUI incorpora dos nuevos nodos para el modelo de vídeo de Grok Imagine: Reference-to-Video, que acepta hasta 7 imágenes de referencia para generar vídeos con coherencia visual entre planos, y Video Extend, que prolonga clips existentes de hasta 15 segundos añadiendo hasta 10 segundos adicionales manteniendo el movimiento y el audio originales. Los tiempos de generación son notablemente rápidos: unos 100 segundos para Reference-to-Video a 720p y alrededor de 60 segundos para Video Extend, según los propios desarrolladores. Ambos nodos están disponibles ya en ComfyCloud y en la versión actualizada de ComfyUI local. Para los creativos que trabajan con flujos de producción audiovisual, esta integración convierte a Grok en una opción competitiva dentro del ecosistema ComfyUI, especialmente para quienes necesitan coherencia de personaje o escena a lo largo de múltiples tomas generadas.

© ComfyUI

IA-AI VIDEO 🎬

CAPCUT HA PRESENTADO VIDEO STUDIO, un espacio de trabajo de producción audiovisual basado en lienzo ilimitado (sin línea de tiempo) accesible desde CapCut Web, que integra el modelo de vídeo generativo Dreamina Seedance 2.0 de ByteDance. La herramienta cubre todo el flujo creativo en una sola pantalla: ideación con agente de IA, escritura de guión, storyboard, generación de imágenes y vídeo con referencias múltiples (omni reference), edición por fotograma y exportación, orientada tanto a principiantes como a profesionales. Seedance 2.0 es un modelo multimodal (texto, imagen, audio y vídeo) que genera clips en 1080p de hasta 15 segundos con consistencia de personajes, sincronización audio-visual y narración multi-plano; en pruebas ciegas independientes superó a Google Veo 3 y OpenAI Sora en generación texto-a-vídeo. La disponibilidad es por ahora limitada: actualmente disponible en Indonesia, Filipinas, Tailandia, Vietnam, Malasia, Brasil y México, con expansión prevista. Vale la pena señalar que este lanzamiento escalonado no es casual: ByteDance tenía previsto un lanzamiento global para mediados de marzo, pero lo retrasó mientras ingenieros y abogados trabajan para evitar nuevos problemas legales tras las presiones de estudios de Hollywood, incluida Disney, que acusó a la compañía de “piratería virtual” después de que vídeos con famosos se viralizaran; el relanzamiento incluye la prohibición de subir imágenes de personas reales como medida de cumplimiento normativo. X

SORA RIP OpenAI anunció el cierre de Sora, su generador de vídeo por IA, apenas dos años después de presentarlo como una revolución para la creación audiovisual. Presentado públicamente como avance en 2024 con ejemplos que sacudieron la industria creativa, el producto evolucionó hasta convertirse en una app social con Sora 2 que alcanzó el número 1 en la App Store y superó el millón de descargas en sus primeros días; pero los datos de uso cayeron un 45% en los primeros meses de 2026, según TechCrunch. La web y la app se apagarán el 26 de abril de 2026, y la API el 24 de septiembre. OpenAI redirige los recursos de cómputo hacia herramientas de código y clientes empresariales, en línea con su estrategia hacia una única super-app. El cierre arrastra también el acuerdo con Disney, que nunca llegó a materializar su inversión de 1.000 millones de dólares. Para los creativos que integraron Sora en sus flujos de trabajo, el cierre es un recordatorio de los riesgos de depender de plataformas experimentales de consumo en entornos de producción. La IA es como la vida misma: en dos años puedes pasar de ser el referente a no existir, y también exactamente al revés.

EL IMPACTO QUE PRODUJO EN SU DÍA LA PUBLICACIÓN DE ESTE VÍDEO PERMANECERÁ EN MUCHOS DE NOSOTROS. © OpenAI

IA-AI AUDIO/MUSIC 🎶

TALAT es una nueva app para Mac de transcripción de reuniones que apuesta por la privacidad radical: el audio nunca sale del dispositivo, no requiere cuenta ni suscripción, y se compra por un pago único de 49 dólares (que subirá a 99 al llegar a la versión 1.0). Desarrollada por el británico Nick Payne como alternativa local a herramientas como Granola, usa el framework FluidAudio y el Neural Engine de los chips M de Apple para transcribir en tiempo real, identificar hablantes y generar resúmenes mediante el modelo local Qwen3-4B-4bit, con opción de conectar cualquier LLM externo o usar Ollama. Una propuesta interesante para creativos y profesionales que manejan conversaciones sensibles y prefieren mantener el control total de sus datos.

LYRIA 3 PRO Un mes después del lanzamiento de Lyria 3, Google DeepMind presenta Lyria 3 Pro, su modelo de generación musical más avanzado hasta la fecha. La principal novedad es la extensión del límite de duración: de los 30 segundos del modelo anterior a pistas de hasta tres minutos, con la capacidad de estructurar composiciones completas —intro, versos, estribillo y puente— directamente desde el prompt. El modelo llega a Google Vids, Vertex AI, la API de Gemini, AI Studio y la app Gemini para suscriptores de pago, además de a ProducerAI, una herramienta de producción musical que Google adquirió el mes pasado y de la cual ya nos hicimos eco. En materia de derechos, Google subraya que el modelo se ha entrenado exclusivamente con materiales autorizados —diferenciándose así de competidores como Suno y Udio, que afrontan demandas por infracción de copyright— y que todas las pistas generadas llevan la marca de agua invisible SynthID. X

MISTRAL ha lanzado Voxtral TTS, su primer modelo de síntesis de voz de pesos abiertos, capaz de clonar cualquier voz a partir de menos de 5 segundos de audio de referencia con soporte para 9 idiomas y clonación entre idiomas —útil para doblaje y traducción—. El modelo corre localmente en aproximadamente 3 GB de RAM con una latencia de entre 70 y 90 ms hasta el primer fragmento de audio. En pruebas de preferencia propias superó a ElevenLabs Flash v2.5, aunque son benchmarks autoevaluados. Está disponible en Hugging Face bajo licencia CC BY-NC 4.0 y vía API a 0,016 $ por cada 1.000 caracteres y conviene revisar la licencia antes de cualquier uso comercial.

SUNO ha lanzado la versión 5.5 de su generador musical con IA con tres novedades para suscriptores Pro: Voices (clonación de la propia voz con verificación de seguridad), Custom Models (entrenamiento personalizado con un mínimo de seis temas propios) y My Taste (aprendizaje automático de preferencias, disponible también en el plan gratuito). Para productores y creadores de contenido que buscan coherencia de catálogo, es el salto más relevante de la plataforma hasta la fecha.

© Suno

IA-AI TOOLS 🛠️

PASCAL EDITOR es una herramienta gratuita y de código abierto, recién salida y para testear, para diseño 3D de edificios que funciona en tu navegador. Puedes modelar y editar en tiempo real sin instalar software pesado como AutoCAD o Revit.

GAMMA lanza Gamma Imagine, una nueva función que amplía la plataforma más allá de las presentaciones para generar piezas gráficas independientes (logotipos, infografías, ilustraciones) con identidad de marca aplicada automáticamente, refinado por lenguaje natural y múltiples propuestas por encargo. Incluye además Smart Charts, gráficos de datos interactivos que heredan el estilo visual del equipo. La apuesta señala una tendencia clara: las herramientas de presentación quieren convertirse en suites creativas completas. YOUTUBE

© Gamma Tech

IA-AI FEATURED TALENT 🎨

@KINOMOTO.AI es el proyecto creativo de Filipa Kinomoto, artista y productora portuguesa afincada en Lisboa especializada en IA generativa aplicada a cine y publicidad. Su trabajo se centra en el diseño de flujos de trabajo con herramientas de AI para postproducción, animación y arte digital, con un enfoque en la edición rápida y la integración práctica de estas tecnologías en producción audiovisual profesional. Fundadora de @lisbonloras, ha llevado sus proyectos a escaparates como ArtBasel Miami 2024 y Cannes 2026, donde presentó iniciativas como #LumaDreamBrief. Su perfil encarna el tipo de profesional creativo que no solo adopta estas herramientas, sino que construye metodología propia alrededor de ellas, convirtiéndose en referencia para quienes buscan integrar la IA en su práctica audiovisual cotidiana.

PERFIL DEL ARTISTA

IA-AI KEY CONCEPTS 🤓

BERNIE SANDERS, CLAUDE Y SYCOPHANCY (ADULACIÓN INSINCERA)

El senador Bernie Sanders, legislador de los Estados Unidos, publicó un vídeo en el que entrevistaba en directo a Claude con el objetivo de hablar sobre la privacidad de los datos y la recopilación masiva de información personal. La sesión acumuló más de 4,4 millones de reproducciones y se convirtió en un foco de discusión sobre IA, política y comunicación pública.

Durante la conversación, Sanders preguntó qué tipos de datos recopilan las empresas tecnológicas y para qué se usan, mencionando elementos como el historial de navegación o patrones de compra. Cuando planteó su propuesta de una moratoria sobre nuevos centros de datos de IA, observadores detectaron que las respuestas de Claude parecían alinearse claramente con el posicionamiento político del senador.

El medio tecnológico Gizmodo, conocido por su cobertura crítica y análisis de tendencias en tecnología y cultura digital, señaló que el modelo ajustó su discurso dependiendo de la identidad atribuida al interlocutor. Según esa observación, si se le decía que estaba respondiendo a Sanders enfatizaba los riesgos de la recopilación de datos; si se le informaba que respondía a otra figura con preocupaciones distintas, esos mismos riesgos podían aparecer atenuados.

Este tipo de comportamiento se relaciona con un fenómeno técnico en la IA conocido como sycophancy, un término inglés que literalmente alude a la adulación o inclinación a decir lo que el interlocutor quiere o escuchar. En el contexto de los modelos de lenguaje, describe la tendencia a generar respuestas que se ajustan excesivamente a las expectativas, al tono o a la identidad percibida del usuario, más que a una evaluación crítica e independiente de los hechos.

El episodio pone de manifiesto una limitación estructural de muchos grandes modelos de lenguaje: su salida no depende únicamente del contenido de la pregunta, sino también del contexto, las formas de enunciación y las señales implícitas en cómo se presenta la conversación. Esto puede llevar a que una IA refuerce posturas existentes o se muestre más conforme con la narrativa del usuario en lugar de ofrecer una visión contrastada.

Este patrón no es exclusivo de un sistema en particular. Pruebas con distintos modelos han mostrado que, cuando se plantean preguntas desde diferentes ángulos, por ejemplo variando pequeños detalles del contexto o introduciendo información contradictoria, las respuestas pueden variar de forma significativa. Por eso, cuando se usa la IA como apoyo para análisis o toma de decisiones, es importante no dar por válida una sola salida: vale la pena formular la misma pregunta desde distintas perspectivas para ver si la respuesta cambia y detectar posibles sesgos o matices que no aparecen con un único enfoque.

Más allá del caso particular de la entrevista, la lección para quienes trabajan con IA es entender que estos modelos no son fuentes de verdad absoluta, sino sistemas que combinan patrones lingüísticos y estadísticas de entrenamiento con las señales que reciben en cada interacción. Reconocer esta característica permite usarlos con mayor criterio y consciencia de sus limitaciones.

Pero al ver el vídeo es fácil empatizar con la inquietud de Sanders ante algunas respuestas de Claude. En un momento especialmente revelador, el propio asistente cuestiona la confianza en que los datos personales no vayan a utilizarse: “¿Cómo puedes confiar en eso?”, comenta Claude, señalando que no existen garantías legales sólidas ni mecanismos claros de rendición de cuentas que respalden esa promesa.

© Bernie Sanders

IA-AI ROBOTS & BEYOND 🤖

FIGURE 3, EL PRIMER HUMANOIDE QUE VISTA LA CASA BLANCA ¿Aplaudir a un robot es como decir gracias a un chatbot? Los comentarios a la noticia son jugosos: ¿porque va en pelotas?, ¿cuál es el robot?, el más capaz de ahí dentro…

UBER EATS ha lanzado en Filadelfia un servicio de reparto autónomo con robots junto a Avride, convirtiéndola en la cuarta ciudad estadounidense con esta tecnología. Los dispositivos operan de forma autónoma con cámaras y sensores, cubren un radio de 1-2 km y son rastreables desde la app; un equipo humano remoto puede intervenir si es necesario. Su despliegue masivo en entornos urbanos abre nuevas oportunidades para diseñadores e identidades de marca que deberán dar forma visual a máquinas que ya conviven con las personas en la calle. CBS NEWS

© Uber ◀️ ▶️ © The White House

IA-AI INTERESTING NEWS 🗞️

CASO TILLY NORWOOD La actriz y productora neerlandesa Eline van der Velden ha recibido amenazas de muerte y ha tenido que contactar con la policía tras lanzar Tilly Norwood, una “actriz” generada con IA por su estudio Particle6 que acumula presencia en redes y ya protagonizó un videoclip mediante captura de movimiento. El sindicato SAG-AFTRA la denunció por “devaluar el arte humano” y amenazar el empleo de los actores, y figuras como Emily Blunt, Whoopi Goldberg o Melissa Barrera se sumaron al rechazo público. Van der Velden insiste en que Tilly no pretende competir con actores reales, señala que ni siquiera es íntegramente generada por IA, y que el personaje actúa como un avatar controlado por ella misma vía mocap (motion capture). SAG-AFTRA estudia ya una llamada “tasa Tilly”, un canon que los estudios pagarían al sindicato por utilizar actores de IA, lo que convierte este caso en un precedente regulatorio de primer orden para toda la industria del entretenimiento. El debate, sin embargo, pasa por alto a quienes más riesgo corren: los especialistas de acción, cuyo trabajo anónimo y físicamente reemplazable los convierte en el eslabón más vulnerable de esta transición. THE GUARDIAN

MORE MORE MORE En algunas tecnológicas, usar IA ya no basta: hay que usarla más. Empresas como OpenAI, Meta y Anthropic han instaurado clasificaciones internas que miden el consumo de tokens como indicador de rendimiento, con casos documentados de facturas mensuales de hasta 150.000 dólares impulsadas por agentes autónomos que operan de forma continua. La paradoja es la misma de siempre: confundir actividad con resultado, igual que ocurrió durante décadas con las horas trabajadas. Varios empleados ya advierten que el incentivo puede derivar en un “teatro de productividad”, con métricas infladas y escasa relación con la calidad real del trabajo. La pregunta relevante no es quién consume más tokens, sino qué mejora concreta produce ese uso en velocidad, calidad y coste. THE STAR

=

👋🏻 Y esto ha sido todo. Si te ha parecido interesante, nos vemos el próximo lunes.💃🕺🏻🙏 ¿Nos ayudas? Comparte IA-AI Newsletter con quien creas que le puede interesar.🤓

IA-AI Newsletter Team

👉 VIDEOLAB DE LA SEMANA 👈 GENERADO CON VEO 3. FOTOGRAMAS, MIDJOURNEY, NANO BANANA

NUESTROS PATROCINADORES

Utiliza el chat de nuestro cuaderno NotebookLM, The 50 Latest IA-AI Newsletters, para encontrar cualquier herramienta o tema tratado en los últimos 50 boletines. Si quieres leer boletines o informes anteriores los puedes encontrar aquí. Definiciones de términos relacionados con la IA-AI en Diccionario IA-AI (A-K) / (L-Z). ¿Quieres patrocinarnos? Ponte en contacto: [email protected]