Inteligencia Artificial - Artificial Intelligence · El boletín informativo que llega los lunes a las 00:01 CET

Las noticias más relevantes de los últimos 7 días recopiladas y analizadas por y para creativos entusiastas de la Inteligencia Artificial - Artificial Intelligence ¡Tira del hilo, tira del link!

IA-AI LANGUAGE MODELS & AGENTS 🧠

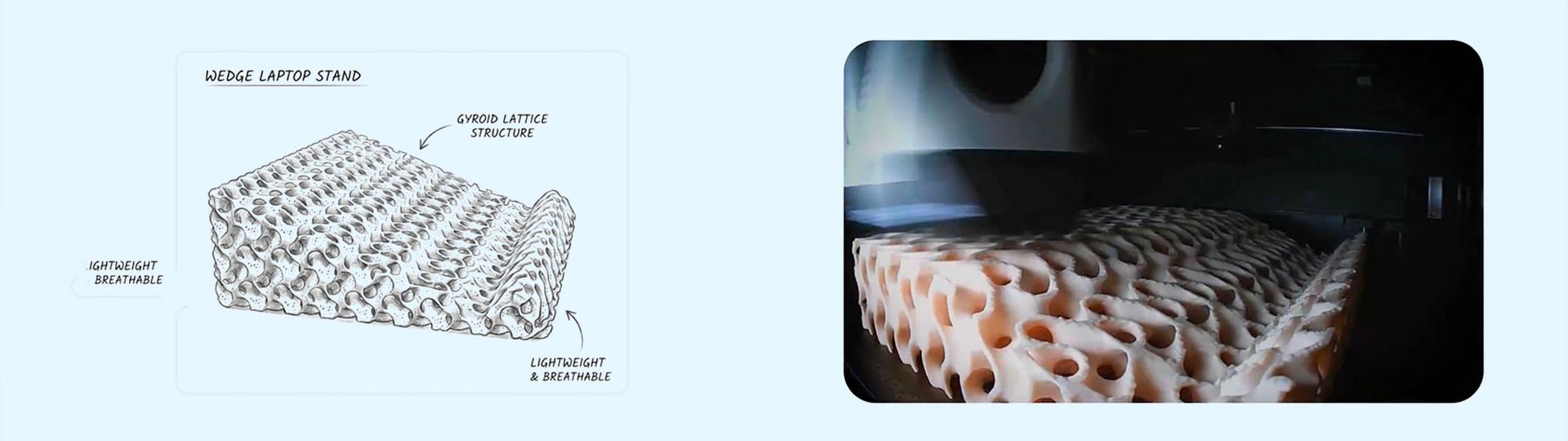

GEMINI 3 DEEP THINK Google ha lanzado recientemente una actualización importante para Gemini 3 Deep Think, su modo de razonamiento avanzado especializado en desafíos científicos, de investigación e ingeniería. Esta mejora permite convertir bocetos dibujados a mano en modelos 3D imprimibles, analizando el dibujo, generando geometría compleja y produciendo archivos listos para impresión. No te pierdas el vídeo en x. Está disponible solo para suscriptores de Google AI Ultra en la app de Gemini, unos 230€ al mes, seleccionando Deep Think en la barra de prompts; las respuestas tardan unos minutos. Este plan premium ofrece acceso prioritario a innovaciones como este modo.

Credit images: Google

IA-AI IMAGE 🎞️

SEEDREAM 5.0 es el nuevo modelo de generación y edición de imágenes de ByteDance, lanzado esta semana, que introduce mejoras significativas en precisión semántica y calidad visual con salida nativa en 4K (4096×4096). Integra RAG (Retrieval-Augmented Generation, o generación aumentada por recuperación), un sistema que combina búsqueda en tiempo real con generación de imágenes para incorporar información actual o conocimiento específico durante el proceso creativo, reduciendo alucinaciones y mejorando la fidelidad en prompts complejos o sensibles al contexto. El modelo también soporta hasta 14 imágenes de referencia para mantener coherencia de personajes o marcas, ofrece edición unificada texto-imagen y fusión multi-imagen, y genera resultados en apenas 2-3 segundos, posicionándose como una herramienta avanzada para workflows profesionales. A día de hoy, solo en DreaminaCapcut y Pippit.

QWEN-IMAGE 2.0 Alibaba ha presentado Qwen-Image-2.0, un modelo generativo de imágenes que unifica creación y edición en un único flujo de trabajo, con soporte para prompts de hasta 1.000 tokens y resolución nativa 2K, lo que permite generar infografías complejas, pósters, diapositivas y escenas fotorrealistas con texto perfectamente renderizado sin necesidad de herramientas externas. El modelo destaca por su adherencia semántica mejorada, su capacidad para producir tipografía profesional legible directamente desde descripciones detalladas, y una arquitectura más ligera que acelera la inferencia sin sacrificar calidad, facilitando iteraciones rápidas en tareas creativas reales.

Credit image: Qwen

IA-AI COMFYUI c

HUNYUAN 3D 3.0 Tencent ha integrado Hunyuan 3D 3.0 en ComfyUI a través de Partner Nodes, permitiendo generar assets 3D listos para producción en minutos a partir de texto, imágenes o bocetos. El modelo simplifica el pipeline tradicional (modelado, texturizado, UVs, render) y permite crear modelos coherentes en estilo, geometría y materiales con un solo prompt, además de soportar generación desde imágenes multi-vista (2–4 vistas) para mejorar la fidelidad geométrica y de materiales. Está orientado a casos como ideación en videojuegos (personajes, props y entornos optimizados para rigging y tiempo real), e-commerce (modelos 3D interactivos desde fotos), diseño industrial (prototipado y piezas listas para impresión 3D) y VFX/animación (UVs profesionales y materiales PBR). Próximamente añadirá edición de texturas, UV semántico y descomposición de partes 3D, reforzando su enfoque hacia workflows más avanzados directamente dentro de ComfyUI.

Credit images: ComfyUI

IA-AI VIDEO 🎬

LIST EN FREEPIK SPACES: LA AUTOMATIZACIÓN QUE ACELERA TU TRABAJO

Del mismo modo que otras plataformas como Krea y Weavy, Freepik actualiza Spaces (lienzo infinito colaborativo) con LIST: una herramienta de batching que genera variaciones masivas de prompts visuales, storyboards o campañas desde una lista simple. Combínala con “Variaciones” (9 planos automáticos de una imagen: reencuadre, demografía, edad) y multi-LLM (GPT, Gemini, Claude Sonnet) para flujos híbridos. YOUTUBE

HIGGSFIELD CINEMA STUDIO: DIRIGE VÍDEOS IA COMO EN UN SET VIRTUAL

Higgsfield ha lanzado Cinema Studio, un módulo que transforma una sola imagen en planos de cine con control preciso de cámara, lentes y óptica. Olvídate de prompts ambiguos: generas un Hero Frame (imagen fija), lo bloqueas como referencia (Character Lock), y configuras cámara (ARRI Alexa, Sony Venice, IMAX), lentes (Canon K35, Cooke S4) y movimientos multi-eje (pan, dolly, FPV) para un shot determinista y consistente.

Incluye simulación óptica real (profundidad infinita, deformaciones de lente), acceso a 3D Scene para órbitas complejas, y Keyframe Interpolation para transiciones suaves entre Start/End Frame. Ideal para spots, cortos o pre-producción: calidad Hollywood a precio accesible vía créditos. Ya acumula hype en Reddit y YouTube por su workflow de virtual production que evita el caos de Sora/Veo, priorizando consistencia facial y óptica. YOUTUBE REDDIT

SEEDANCE 2.0, EL NUEVO MODELO QUE ESTÁ REVOLUCIONÁNDOLO TODO ByteDance lanzó Seedance 2.0, un modelo de generación de video con IA que está superando a Sora 2, Veo 3.1 y Kling 3.0 con un salto cualitativo impresionante: videos de hasta 15 segundos en resolución 2K, audio nativo con sincronización labial, consistencia de personajes y realismo fotográfico que acepta entradas de texto, imagen, audio y vídeo. Creadores ya están produciendo escenas cinematográficas completas de 2 minutos por $60. El acceso internacional es limitado: está disponible en plataformas chinas como Jimeng AI, Xiaoyunque y Doubao (requieren número telefónico +86), mientras que la versión internacional “Dreamina” aún no lo tiene habilitado para todos. El lanzamiento global completo está previsto para el 24 de febrero de 2026. Mientras tanto, Disney envió una carta de cese y desistimiento acusando a ByteDance de usar sus personajes de Star Wars y Marvel sin autorización para entrenar el modelo, desatando una batalla legal que podría marcar precedente en la industria de IA generativa.

A parte de los casos que podemos ver en su blog, en x abundan los vídeos sorprendentes que confirman que es un modelo revolucionario en muchos campos… emociones, UGC (User-Generated Content), motion design, animación, escenas de lucha, superhéroes…

Credit image: ByteDance

IA-AI AUDIO/MUSIC 🎶

AUDIOBOOKS ElevenLabs ha lanzado esta semana Audiobooks, una suite completa de producción de audiolibros impulsada por IA en ElevenCreative, que permite crear, refinar y publicar audiolibros en un solo flujo desde el borrador hasta la distribución global, con voces expresivas, edición escena por escena y exportación directa a ElevenReader o plataformas como Spotify, todo en un clic para autores independientes. YOUTUBE

IA-AI ADOBE A

ADOBE FIREFLY ahora ofrece generaciones ilimitadas de imágenes y videos para suscriptores, integrando modelos líderes como Google Nano Banana Pro, GPT Image Generation y Runway Gen-4 Image, junto con los modelos seguros de Adobe. Esto permite una exploración creativa continua sin restricciones, disponible en Firefly, Firefly Boards y la app móvil. Firefly se posiciona como un estudio AI todo-en-uno, conectando generaciones con herramientas como Firefly Boards para ideación colaborativa, editor de video y edición por prompts. El 86% de los creadores usa AI diariamente, y la longitud media de prompts se duplicó en 2025, reflejando un uso más conversacional. BLOG ADOBE

IA-AI FEATURED TALENT AND VIDEOS 🎨

ARTISTA DE LA SEMANA @SOFIACRESPO (Argentina, 1991) es una de las voces más destacadas del arte generativo contemporáneo. Desde Lisboa, donde trabaja como parte del dúo Entangled Others, utiliza redes neuronales para explorar la intersección entre lo orgánico y lo artificial, creando lo que denomina “historia natural artificial”. Su obra reimagina la naturaleza a través de algoritmos, generando criaturas y formas que parecen surgir de un ecosistema digital alternativo. Entre sus proyectos más conocidos están Neural Zoo y Structures of Being, un impresionante mapping en la Casa Batlló de Barcelona que dialoga con Gaudí. Reconocida con premios como el AI Newcomer Award (2021) y el reciente ABS Digital Art Prize 2025, Crespo ha exhibido en el V&A Museum de Londres y Times Square. Su trabajo cuestiona dónde termina la naturaleza y comienza la máquina, proponiendo una visión poética de la evolución en la era digital.

PERFIL DE LA ARTISTA

VÍDEOS DE LA SEMANA

Esta semana no hay vídeo de la semana. Pero si pondremos la frase que más hemos leído mirando los vídeos de las novedades que puedes encontrar en la sección IA-AI VIDEO. “Hollywood está jodido”. Sin duda.

IA-AI KEY CONCEPTS 🤓

CHAIN-OF-THOUGHT: ENSEÑANDO A LA IA A PENSAR EN VOZ ALTA Imagina que le pides a alguien resolver un problema matemático complejo. Una persona podría darte directamente la respuesta (a veces equivocada), o podría mostrarte su razonamiento paso a paso: “primero sumo esto, luego divido aquello, entonces…”. La Chain-of-Thought (Cadena de Pensamiento o CoT) es exactamente eso, pero aplicado a los modelos de lenguaje: una técnica que les obliga a “mostrar su trabajo” antes de llegar a la respuesta final, mejorando dramáticamente su precisión en tareas que requieren razonamiento.

Introducida en 2022 por investigadores como Jason Wei, CoT surgió de una observación simple pero poderosa: cuando los LLMs desglosan un problema en pasos intermedios explícitos, imitan el razonamiento humano secuencial y cometen menos errores. Esto ha sido especialmente revolucionario en áreas como matemáticas, lógica, planificación o análisis ético, donde el camino hasta la respuesta es tan importante como la respuesta misma. Lo fascinante es que no requiere reentrenar el modelo, solo cambiar cómo le preguntamos.

Existen varias formas de implementar CoT. La más básica es el Zero-shot CoT, donde simplemente añades “Pensemos paso a paso” a tu pregunta, sin necesidad de ejemplos previos. Para tareas más complejas está el Few-shot CoT, donde incluyes ejemplos previos con sus cadenas de razonamiento completas, como plantillas que el modelo seguirá. Y existe también Auto-CoT, que automatiza la generación de estas cadenas para evitar errores humanos al crear los ejemplos. Cada variante se adapta a diferentes niveles de complejidad.

Aquí está lo crucial: los LLMs no activan CoT automáticamente. Debes pedirlo explícitamente en tu prompt. Frases como “Razona tu respuesta”, “Desglosa en pasos” o “Explica tu proceso de pensamiento” son la clave. Por ejemplo, en lugar de preguntar “¿Cuánto es 15% de 340?”, prueba: “Calcula el 15% de 340. Piensa paso a paso”. La diferencia en precisión puede ser notable, especialmente en problemas con múltiples operaciones o que requieren lógica encadenada.

Para quienes trabajamos con IA generativa en creatividad, CoT no es solo para matemáticas. Úsalo cuando pidas a Claude, ChatGPT… que planifique un proyecto creativo, analice el tono de un texto, estructure un guion, o tome decisiones editoriales. Al forzar el razonamiento explícito, no solo obtienes mejores resultados: también entiendes por qué la IA llegó a esa conclusión, lo que te permite refinar y colaborar mejor con ella. Es convertir la caja negra en una ventana transparente.

IA-AI ROBOTS & BEYOND 🤖

ROBOT HUMANOIDE Cualquier día se presentan a campeonatos de gimnasia artística.

IA-AI INTERESTING NEWS 🗞️

SOMETHING BIG IS HAPPENING Un desarrollador de IA con 6 años en la industria explica con brutal honestidad por qué este momento se parece al inicio de la pandemia: todos pensamos que es exagerado hasta que de repente todo cambia. La IA dejó de ser su asistente para convertirse en quien hace su trabajo mejor que él. Y lo que ya pasó en tech está a punto de llegar a tu industria. No es un artículo más sobre “el futuro de la IA”—es una advertencia urgente de alguien que ya está viviendo ese futuro y cree que te quedan entre 1 y 5 años para adaptarte. Quizás te venga bien un vino después de leerlo.

REPORT: AI DOESN’T REDUCE WORK—IT INTENSIFIES IT La adopción entusiasta de IA generativa no está reduciendo el trabajo, sino intensificándolo: en un estudio de ocho meses en una empresa tecnológica de 200 empleados, los trabajadores ampliaron el alcance de sus tareas, aceleraron su ritmo, difuminaron los límites entre trabajo y descanso y multiplicaron la multitarea, todo por iniciativa propia, al sentir que “hacer más” era ahora posible y estimulante. Este aumento voluntario puede parecer una victoria en productividad, pero a medio plazo genera sobrecarga cognitiva, fatiga y riesgo de burnout, además de expectativas crecientes de velocidad y disponibilidad. Los autores proponen que las organizaciones desarrollen una “AI practice”, es decir, normas claras sobre cómo y cuándo usar la IA, incorporando pausas intencionales, mejor secuenciación del trabajo y espacios de conexión humana para evitar que la aceleración constante erosione la calidad, la toma de decisiones y la sostenibilidad del rendimiento. HARVARD BUSINESS REVIEW

=

👋🏻 Y esto ha sido todo. Si te ha parecido interesante, nos vemos el próximo lunes.💃🕺🏻🙏 ¿Nos ayudas? Comparte IA-AI Newsletter con quien creas que le puede interesar.🤓

IA-AI Newsletter Team

👉 VIDEOLAB DE LA SEMANA 👈 GENERADO CON WORKFLOW WEAVY (🎞️ NBP 🎬 KLING) & 🎶 SUNO

NUESTROS PATROCINADORES

Utiliza el chat de nuestro cuaderno NotebookLM, The 50 Latest IA-AI Newsletters, para encontrar cualquier herramienta o tema tratado en los últimos 50 boletines. Si quieres leer boletines o informes anteriores los puedes encontrar aquí. Definiciones de términos relacionados con la IA-AI en Diccionario IA-AI (A-K) / (L-Z). ¿Quieres patrocinarnos? Ponte en contacto: [email protected]