Inteligencia Artificial - Artificial Intelligence · El boletín informativo que llega los lunes a las 00:01 CET

Las noticias más relevantes de los últimos 7 días recopiladas y analizadas por y para creativos entusiastas de la Inteligencia Artificial - Artificial Intelligence ¡Tira del hilo, tira del link!

IA-AI Language Models

ChatGPT: por si no lo sabes

OpenAI ha lanzado Operator, un asistente autónomo que usa IA-AI para navegar por la web y completar tareas como reservas, compras o pedidos, ¡sin necesidad de integraciones! Combina la visión de GPT-4o con razonamiento avanzado para actuar como un humano. Por ahora, está en fase de prueba para usuarios Pro en EE.UU., pero promete revolucionar cómo interactuamos con la IA. Youtube

DeepSeek-R1

Atentos a este nuevo protagonista. DeepSeek-R1, es un nuevo modelo de razonamiento de código abierto desarrollado por el laboratorio chino DeepSeek, y marca un hito al rivalizar con ChatGPT (o1 de OpenAI) en rendimiento, especialmente en matemáticas, código y razonamiento, superando incluso a GPT-4o y Claude 3.5 Sonnet en ciertos benchmarks. Destaca por su enfoque innovador: utiliza aprendizaje de refuerzo puro, permitiendo que el modelo aprenda autónomamente mediante prueba y error (similar a AlphaGo), sin depender de grandes datasets, logrando un salto del 15,6% al 86,7% en resolución de problemas matemáticos. Disponible bajo licencia MIT, ofrece versiones desde 1.500 millones hasta 671.000 millones de parámetros —incluso ejecutables en portátiles— y una API a solo el 5-10% del costo de o1 (0,14$ vs 7,5$ por millón de tokens). Su apertura contrasta con el giro cerrado de OpenAI, subrayando la ironía de que una empresa china lidere la democratización de IA avanzada, accesible y económica. Un avance que redefine la competencia en el sector y que en tan solo unos días se ha colocado como la aplicación gratuita más descargada en EEUU. ¡Pruébalo gratis activando “DeepThink” en su interior! No te defraudará.

Perplexity

Perplexity ha lanzado un asistente móvil gratuito que controla aplicaciones mediante voz y gestos, desafiando a gigantes como Google Gemini y Siri. Integrado con apps como Uber y OpenTable, permite ejecutar tareas complejas (ej: buscar restaurantes y reservar mesa) manteniendo el contexto durante la interacción. Además, incorpora capacidades multimodales, usando voz y cámara para obtener información del entorno. Disponible en Android, este lanzamiento confirma que la carrera de los agentes IA no está limitada a los grandes players. X

IA-AI Image

Midjourney: novedades inminentes

Video Próximamente lanzarán 2 modelos (rápido/barato vs. lento/caro) para medir el interés de la comunidad.

V7 Mejoras clave en calidad, comprensión de prompts y multilingüismo. Lanzamiento previsto mediados de febrero. Si hay suerte, con omni reference* y batch mode (lotes).

3D Nuevas funciones como movimiento de cámara y rerenderizado en espacio 3D.

Futuro Proyectos secretos en desarrollo, mejoras en escalado y procesamiento Real-time.

*¿Qué es Omni Reference?

Es una característica que permitirá a los usuarios referenciar y replicar de manera precisa logos, objetos o elementos específicos en las imágenes generadas.

¿Cómo funcionaría?

Referencia precisa Podrás cargar una imagen de un logo, objeto o diseño, y la IA lo integrará de manera coherente en las nuevas creaciones.

Consistencia visual Mantendrá detalles como colores, formas y estilos, algo que actualmente puede ser complicado.

Aplicaciones prácticas Ideal para branding (creación de marcas), diseño de productos, o cualquier proyecto que requiera repetir elementos visuales con exactitud.

Si tienes un logo de una empresa y quieres generar imágenes publicitarias con ese logo integrado de manera natural, Omni Reference te permitirá hacerlo sin perder calidad ni detalles.

En resumen, esta función podría ser un cambio radical para diseñadores y creadores de contenido, ofreciendo mayor control y precisión en la generación de imágenes.

Runway

Sí, Runway en la sección de Image, no nos hemos equivocado. Con su nuevo modelo de generación de imágenes Frames, ofrece un control estilístico y fidelidad visual sin precedentes. Disponible ahora para los planes Unlimited y Enterprise. X

IA-AI Hugging Face Spaces / Replicate / Fal +

recraft-ai / recraft-clarity-upscale Clarity Upscale mejora las imágenes haciéndolas mucho más nítidas, sin inventar detalles, para una calidad web o de impresión perfecta. 0,04$ / imagen o 25 imágenes por 1$.

recraft-ai / recraft-creative-upscale Creative Upscale mejora las texturas, los detalles finos y la profundidad para obtener imágenes impresionantes. 0,80$ / imagen.

minimax/video-01 También conocido como Hailuo. Usa una referencia de tema para hacer un vídeo con un personaje y el modelo S2V-01. 0,50$ por vídeo

Hunyuan3D-2 Para crear y animar activos 3D texturizados de alta calidad.

Malla 3D obtenida con Hunyuan3D-2 a partir de la imagen estática

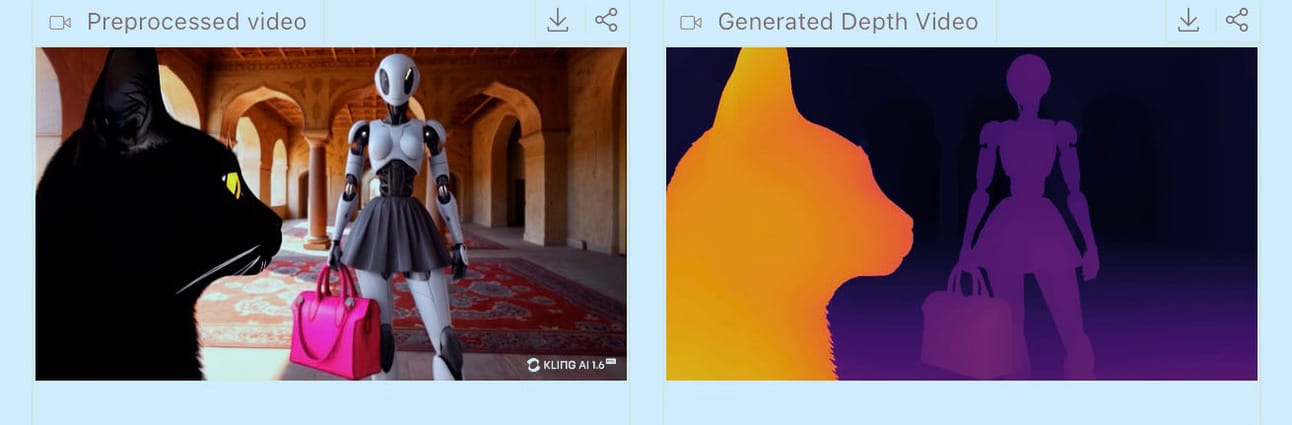

Video Depth Anything Depth Anything es una tecnología que estima la profundidad en imágenes, pero falla en videos largos porque pierde consistencia. Ahora, han creado Video Depth Anything, que mejora esto usando un nuevo sistema que mantiene la calidad y eficiencia incluso en videos de varios minutos. Además, funciona en tiempo real (30 FPS) y no necesita datos extra para aprender. Aquí tienes una demo que puedes probar sin coste. ¡Es un gran avance para aplicaciones prácticas! ¿Y cuales son estas?

Las aplicaciones prácticas de Video Depth Anything (y la estimación de profundidad en videos en general) son muchas y muy útiles:

Realidad virtual y aumentada (VR/AR)

Para crear experiencias inmersivas realistas, como juegos o simulaciones, donde la profundidad es crucial para que los objetos se vean bien integrados en el entorno.Vigilancia y seguridad

Mejorar sistemas de cámaras para detectar movimientos, distancias o comportamientos anómalos en tiempo real.Cine y producción de video

Facilitar efectos visuales, como añadir objetos en escenas o ajustar fondos, manteniendo la coherencia en videos largos.Robótica y vehículos autónomos

Ayudar a robots y coches autónomos a "ver" y entender el espacio en 3D, evitando obstáculos y navegando de forma segura.Medicina y cirugía

Mejorar herramientas de diagnóstico por imagen o asistir en cirugías guiadas por video, donde la precisión de profundidad es vital.Drones y mapeo

Crear mapas 3D de terrenos o estructuras a partir de videos grabados por drones.

Imagen derecha: ejemplo de un fotograma conseguido con Video Depth Anything

IA-AI Video

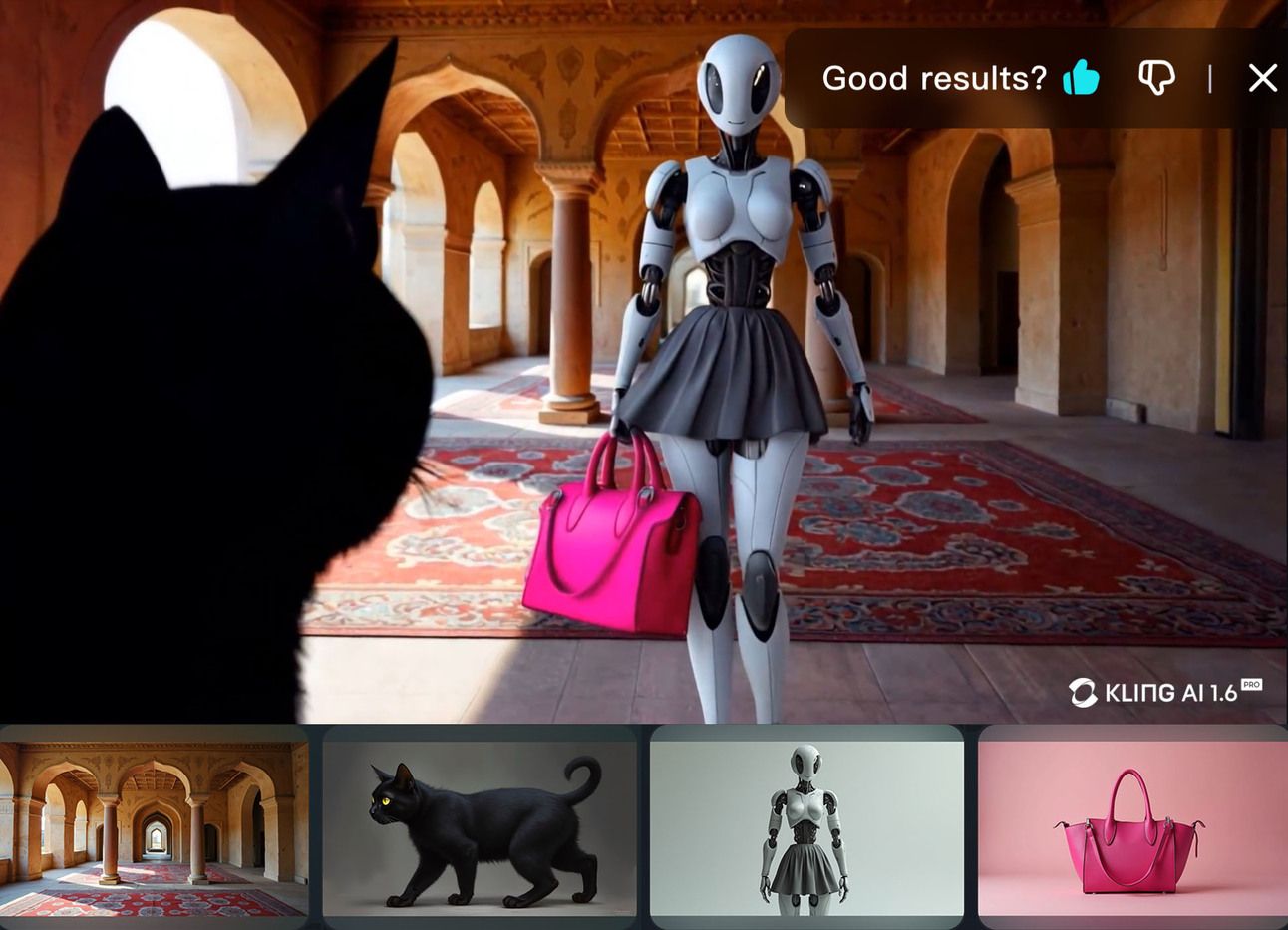

Kling Elements

La función Elements ya está disponible con el modelo KLING AI 1.6 para la generación de imagen a vídeo. Sube de 1 a 4 imágenes, con la opción Elements (en vez de Frames) y describe la escena y la acción en el prompt. Como resultado tendrás un vídeo con tus protagonistas. Esto puede ser particularmente útil para lograr una apariencia consistente de un personaje en diferentes tomas. Realmente es otro peldaño hacia el control total en la generación de vídeos IA-AI.

4 imágenes + un prompt “A female humanoid robot walks through a Persian room with a pink bag and a black cat looks at her” = video 👉 ver en X

Hailuo AI

Consistencia entre todos los personajes, expresiones y estilos con el modelo S2V-01 que está abierto a todos los usuarios y con tan solo una imagen de referencia sin entrenamientos. 100 créditos diarios gratuitos. HailuoAI

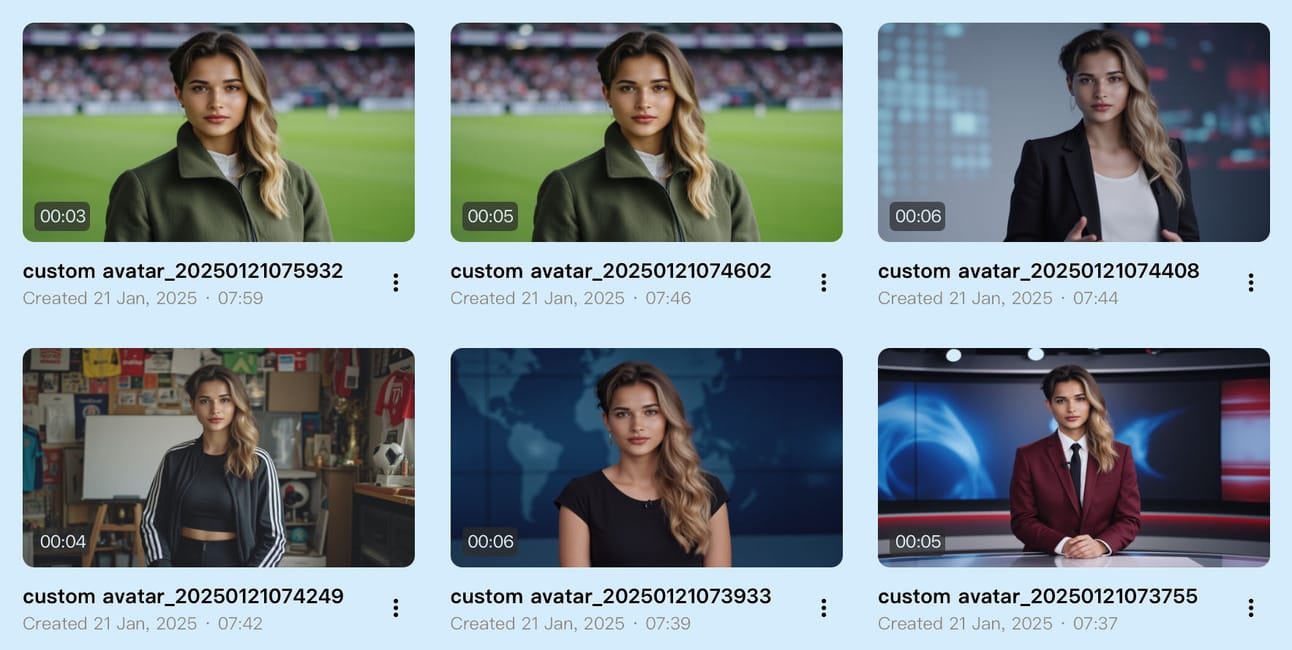

Avatares

Humba te permite generar vídeos con avatares y voz a partir de una foto y cientos de plantillas disponibles. Aprovecha los créditos gratuitos para probar esta herramienta que hemos comprobado que es fácil, rápida y ofrece resultados de calidad. ¡Comprueba tú mismo su facilidad y calidad viendo el resultado aquí!

Avates para redes sociales, introducciones de productos…

IA-AI Featured Artists and Videos

Artista destacado de la semana: Freddy Chaves Olmo Filmmaker & VFX Creative Director (Powered by AI)

Vídeos destacados de la semana: —

IA-AI Key Concepts

El experimento de la habitación china. ¿Puede una máquina entender realmente?

Imagina que estás en una habitación cerrada, con un manual de instrucciones en español y cajas llenas de símbolos chinos que no entiendes. Alguien te pasa mensajes en chino por una rendija; tú buscas en el manual cómo combinar esos símbolos para generar una respuesta coherente, la escribes y la devuelves. Para quien está fuera, pareces dominar el chino, pero en realidad solo sigues reglas sin comprender nada. Este es el experimento mental que propuso el filósofo John Searle en 1980 para cuestionar si la IA puede tener verdadera comprensión o solo simularla.

Searle usó esta metáfora para criticar la idea de que una máquina que procesa información (como los ordenadores) pueda tener conciencia o significado. Su argumento es simple: “la sintaxis (manipular símbolos) no garantiza la semántica (entender su significado)”. Por ejemplo, un modelo como ChatGPT genera textos impresionantes siguiendo patrones estadísticos, pero ¿sabe lo que dice? Para Searle, la respuesta es no: es como el humano en la habitación, repitiendo reglas sin consciencia.

Este debate sigue vivo hoy. Defensores de la IA contraargumentan que, aunque un sistema individual no entienda, la complejidad de las redes neuronales podría generar una forma de entendimiento emergente. Otros, como el filósofo Daniel Dennett, señalan que incluso los humanos aprendemos mediante repetición y patrones, no muy distinto a lo que hace la IA. Pero Searle insiste: sin una experiencia subjetiva (qualia), como el dolor o el color rojo, no hay verdadera comprensión.

¿Qué implica esto para nosotros? Si aceptamos que la IA solo simula inteligencia, surgen preguntas incómodas: ¿Podemos confiar en que un chatbot médico entienda los síntomas que describe? ¿Es ético delegar decisiones creativas o emocionales en sistemas que, en el fondo, son máquinas de estadística? Estas dudas han impulsado campos como la IA explicable, –de la cual hablamos en W46/2024- que busca hacer transparentes los procesos de los algoritmos.

El experimento de Searle no resolvió el misterio de la consciencia artificial, pero sí nos dejó una lección clave: la inteligencia humana no es solo cálculo, sino experiencia. Mientras la IA avanza, este debate filosófico se vuelve cada vez más práctico, desafiándonos a definir qué significa realmente entender… y hasta dónde queremos que lleguen las máquinas.

IA-AI Interesting News

AI in 2025: How Brands & Creators are Redefining Innovation 📖

La empresa Leonardo.AI ha presentado el primer número del magazine Spill, titulado “The Advertising & Marketing Edition, AI in 2025: How Brands & Creators are Redefining Innovation”. Desde la hiperpersonalización hasta las activaciones de IA del mundo real, descubre cómo las marcas y los creadores están redefiniendo la innovación en 2025. Interesante y gràficamente atractivo, lo puedes descargar aquí.

Paul Schrader 🎥

El cineasta Paul Schrader (Toro Salvaje) se declara “impactado” tras probar ChatGPT para generar ideas de películas: “¿Por qué los guionistas deberían pasar meses buscando una buena idea si la IA puede dar una en segundos?”. Schrader, que ya advirtió durante la huelga de guionistas de 2023 que “la IA será parte de nuestro futuro”, destaca su potencial para crear guiones eficientes, aunque insiste en que los escritores deben recibir compensación si se usa la tecnología. Un debate candente sobre creatividad vs. automatización. Indiewire

Stargate Project. Para que nos suene 🚀

OpenAI, SoftBank y Oracle han lanzado The Stargate Project, un megaproyecto de 100.000 millones de dólares (con planes de llegar a 500.000 millones) para expandir la infraestructura de IA en EE.UU. El primer centro de datos, en Texas, ya está en construcción y se espera crear 100.000 empleos. Según Sam Altman, CEO de OpenAI, «este será el proyecto más importante de esta era», con el objetivo de asegurar el liderazgo estadounidense frente a China en la carrera de la IA, impulsando la economía y la seguridad nacional. CNN Bussiness

Mientras tanto Ellon Musk y Sam Altman ya se discuten en X

=

👋🏻 Y esto ha sido todo. Si te ha parecido interesante, nos vemos el próximo lunes.💃🕺🏻🙏 ¿Nos ayudas? Comparte IA-AI Newsletter con quien creas que le puede interesar.🤓

IA-AI Newsletter Team

✨Informativos IA-AI Newsletter 🙂 Vídeo avatar generado con Humma a partir de un retrato creado con Midjourney. Con voces en inglés y castellano. 👉 VideloLab de la semana en X

Si quieres leer boletines o informes anteriores los puedes encontrar aquí

Y recuerda que siempre puedes consultar definiciones de términos relacionados con la IA-AI en nuestro pequeño y modesto Diccionario IA-AI

¿Quieres patrocinarnos? Ponte en contacto: [email protected]

Los boletines contienen algunos artículos solo visibles para suscriptores del